В Турции литосферные плиты сдвинулись более чем на 3 метра

Ученым давно известно, что территория Турции находится в сейсмоопасной зоне — на стыке двух литосферных плит. К примеру, Немецкий исследовательский центр геологических наук (GFZ) в Потсдаме занимается сейсмическим мониторингом в этой зоне еще с 1980-х годов. Данные показывали, что риск землетрясений крайне высок во всем регионе вокруг Мраморного моря. Более того, за последнюю четверть века в Турции уже было семь землетрясений с магнитудой 7 и более баллов. Однако землетрясение, произошедшее 6 февраля 2023 года стало неординарным сейсмологическим событием не только для Турции, но и всего мира, по которому прокатилась волна землетрясений. Но с чем это связано и насколько грозит последствиями в будущем не только Турции, но и другим регионам?

Что такое литосферные плиты и почему происходят землетрясения

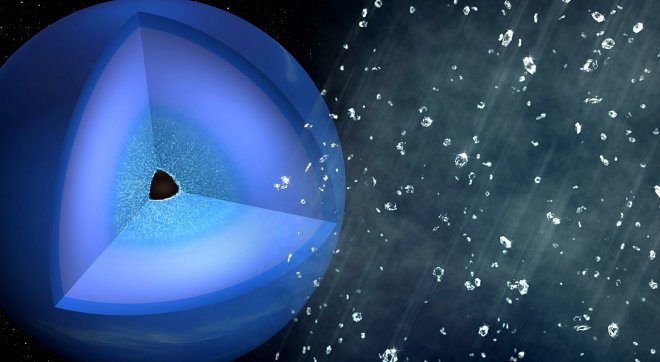

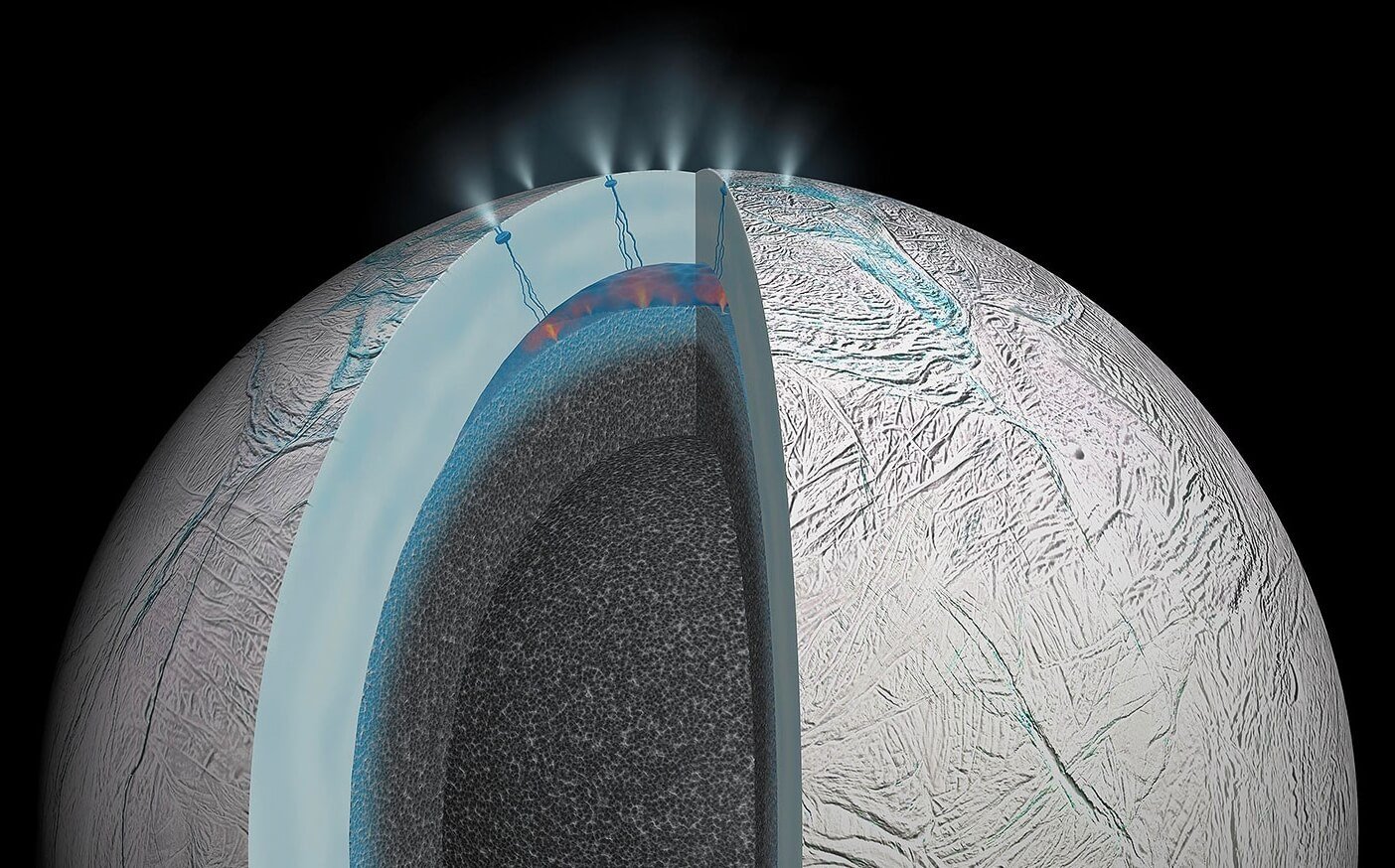

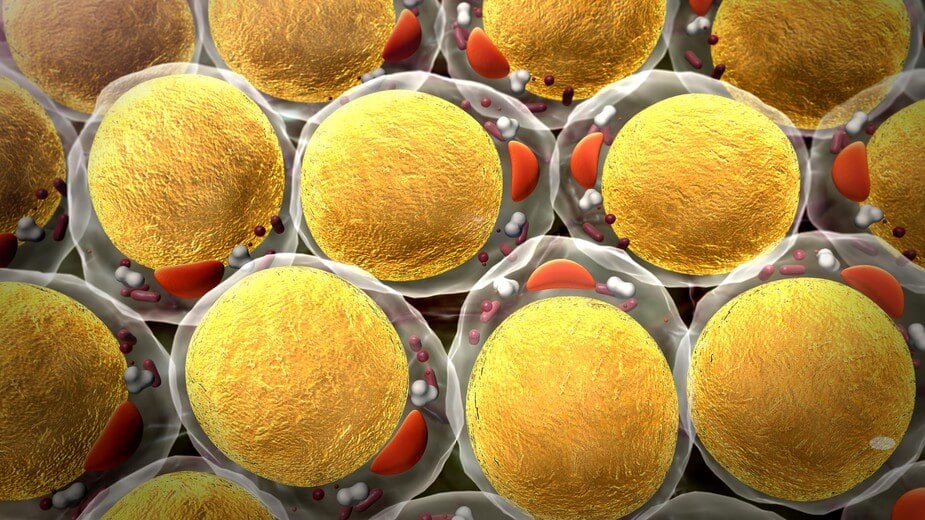

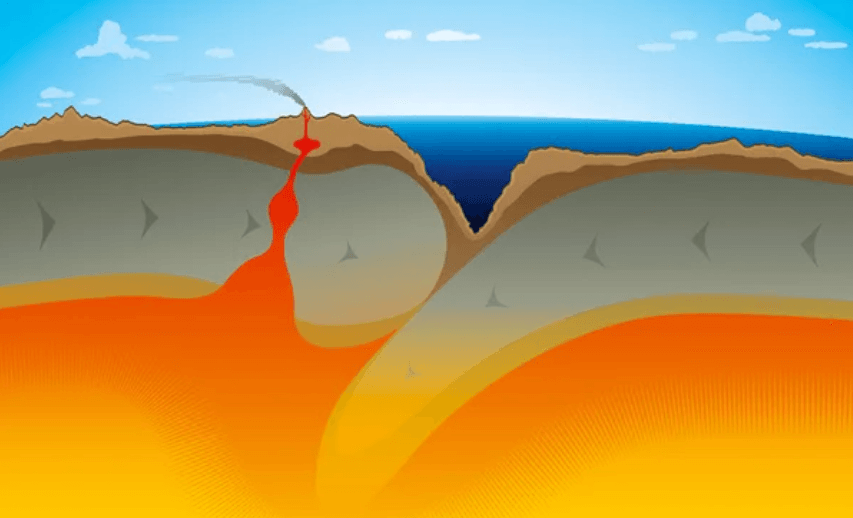

Земля, в отличие от многих других планет солнечной системы, имеет не монолитную кору, а множество отдельных литосферных плит, которые дрейфуют в вязкой мантии. Обычно они смещаются в год на несколько сантиметров, что является нормальным явлением. Но иногда эти плиты сталкиваются друг с другом.

Как правило, после столкновения плиты начинают давить друг на друга, то есть между ними возникает напряжение, которое нарастает до тех пор, пока не начинает превышать их прочность. В результате возникает разлом или одна из полит начинает уходить под другую. То есть в этот момент происходит разрядка напряжения, и в результате чего плиты резко приходят в движение. При этом на поверхности земле возникают те самые разрушительные толчки.

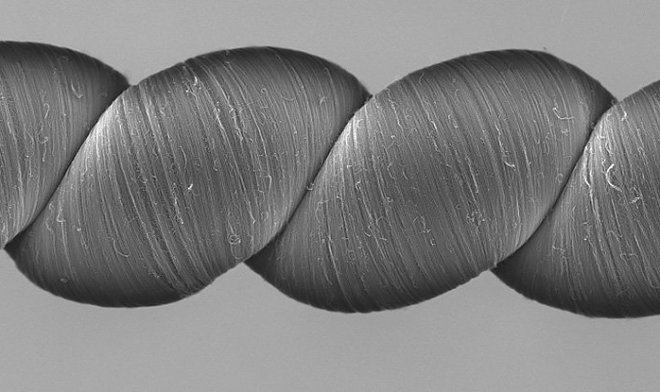

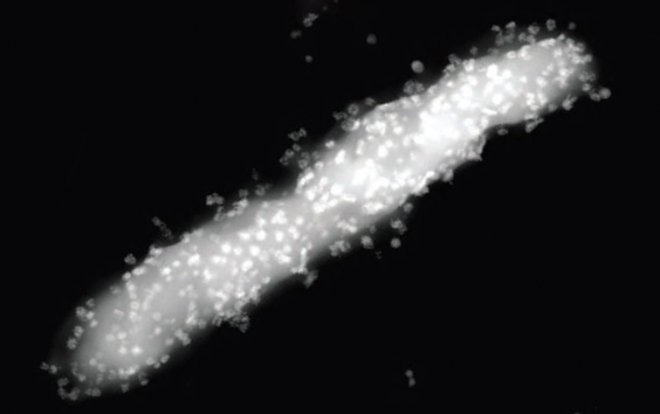

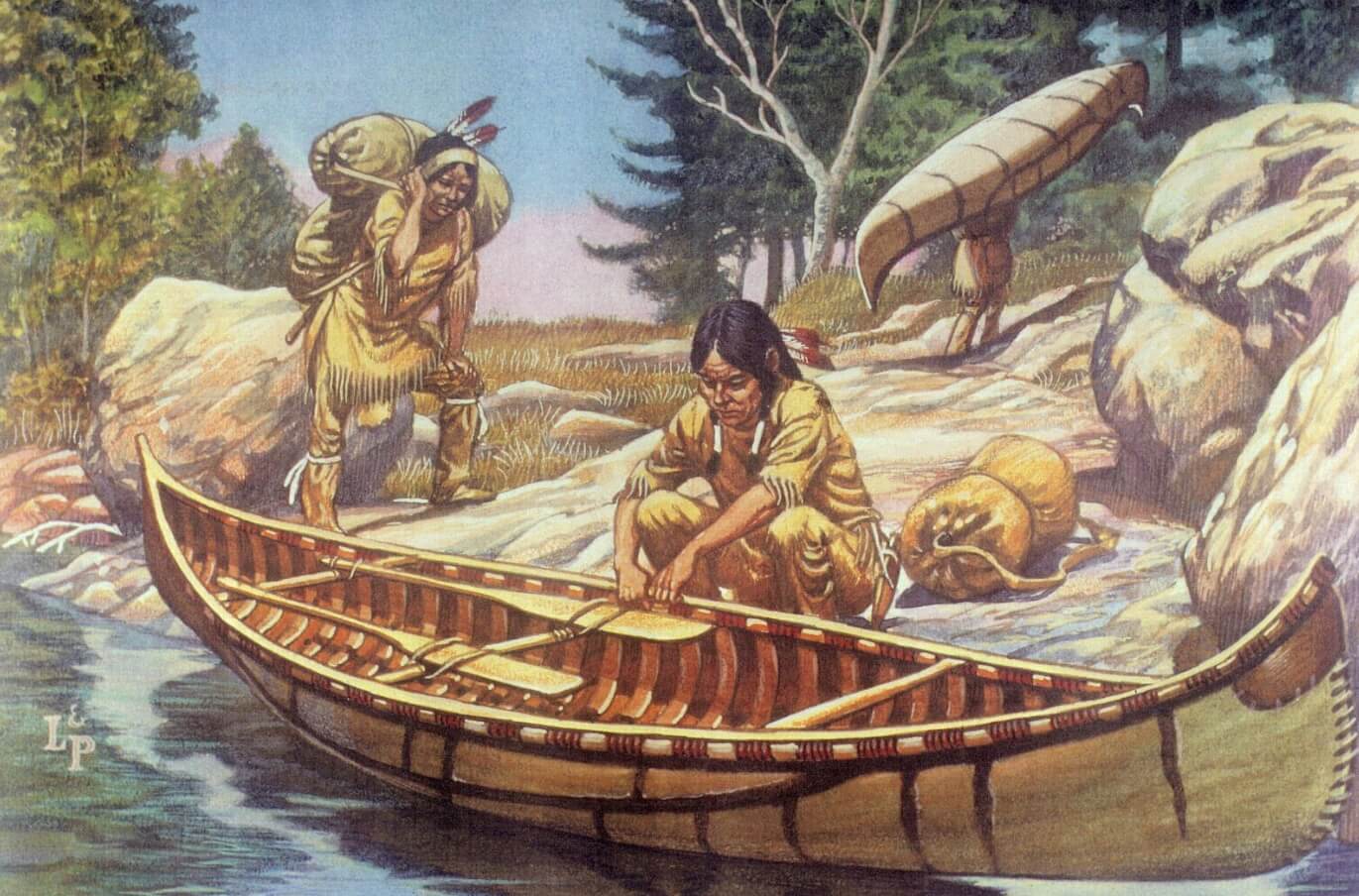

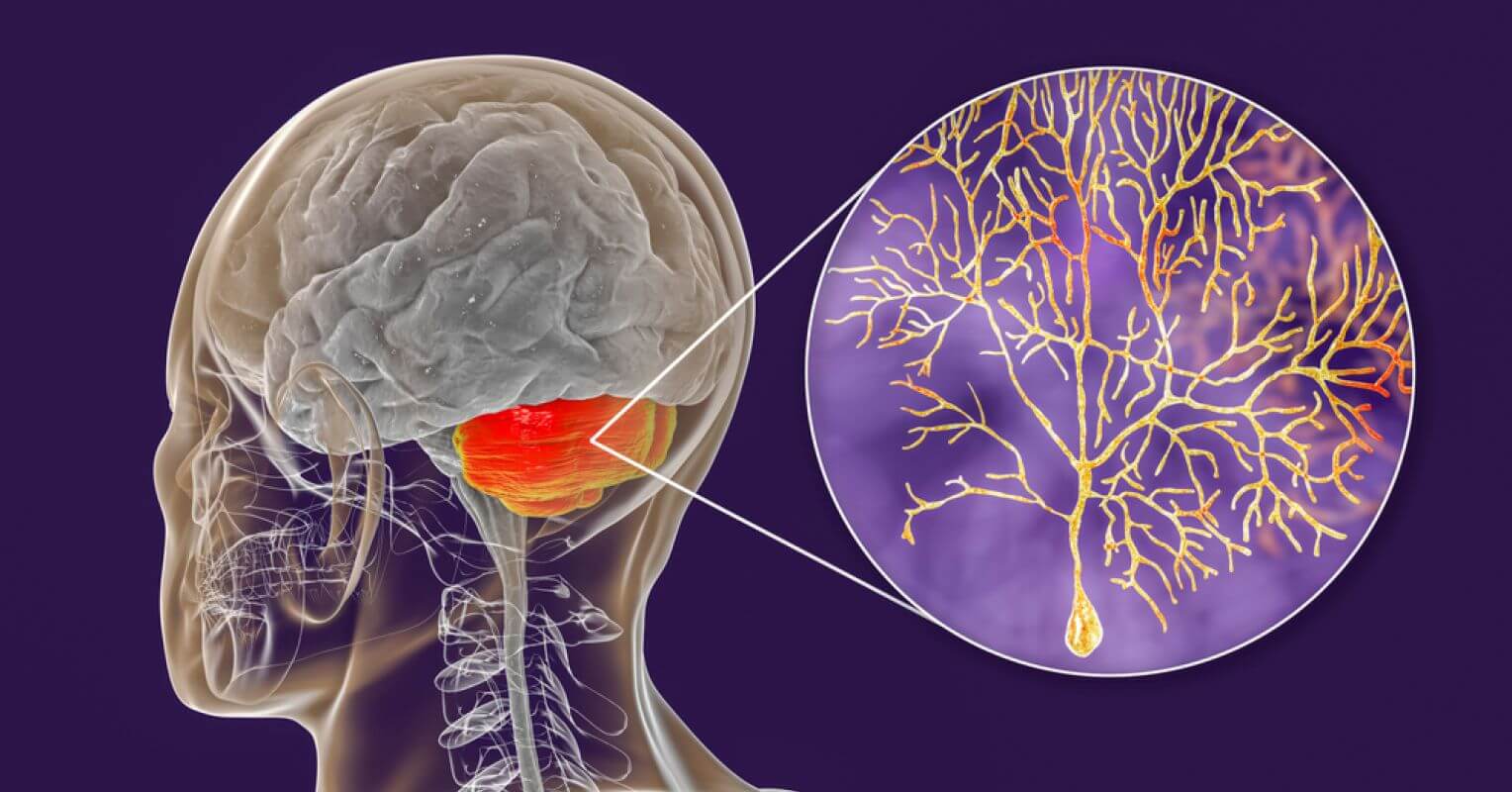

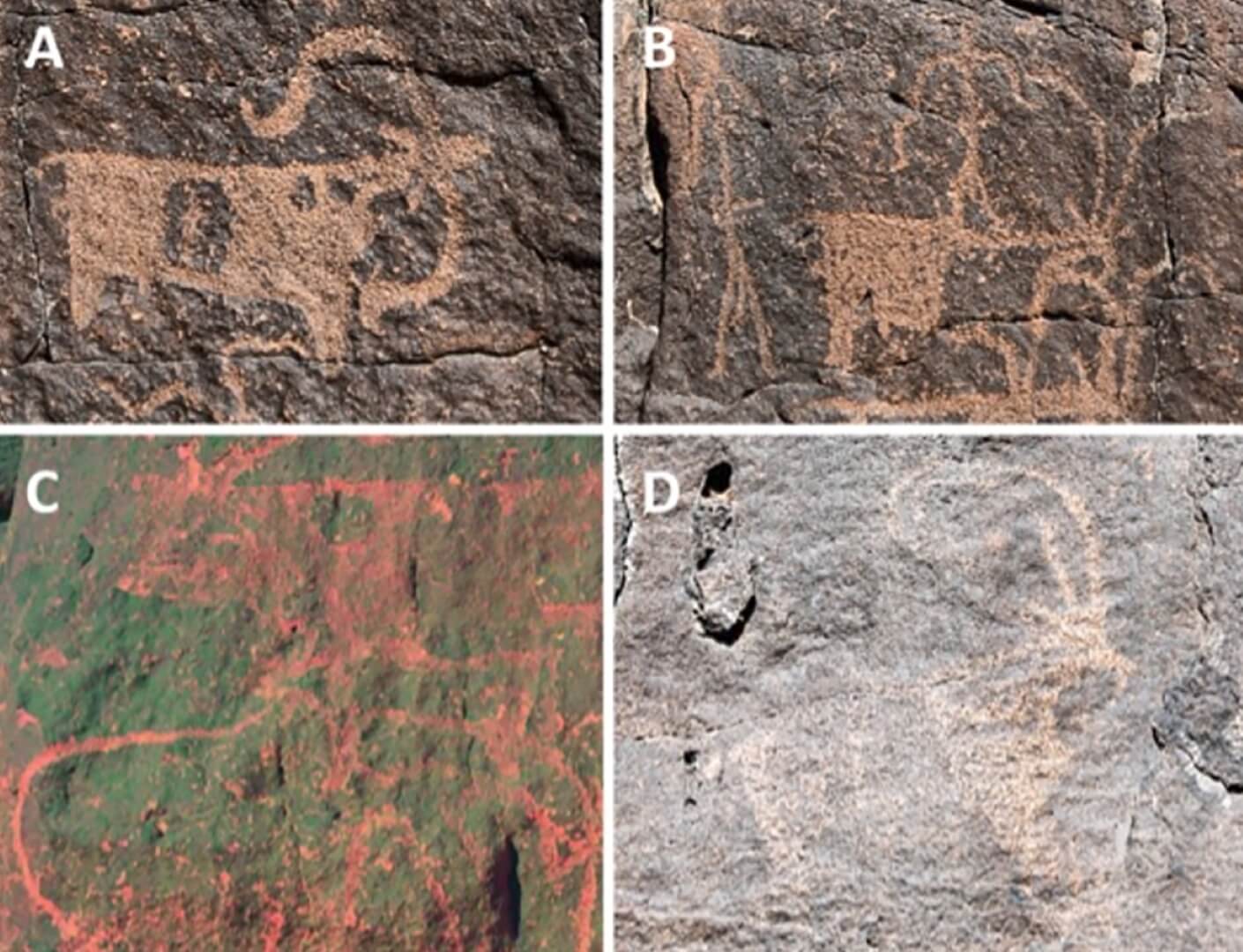

Землетрясение происходит, когда литосферные плиты сдвигаются друг относительно друга

Именно по этой причине наиболее сейсмоопасными считаются районы, которые расположены на стыке двух литосферных плит или у их края. Примером является Турция, большая часть которой находится на Анатолийской плите, а юго-запад — на Аравийской плите. Между ними имеется глубокий тектонический разлом.

Что произошло с тектоническими плитами в Турции

Сейсмологи еще несколько лет назад говорили, что литосферные плиты на территории Турции, фактически, сцеплены. Поэтому землетрясение было лишь делом времени. Как отмечают эксперты Аравийская плита давит на Анатолийскую на протяжении сотен лет, в результате чего напряжение накапливаетя. Так как мощных землетрясений в Турции не было давно, скопилось много энергии.

Когда эта энергия высвободилась, плиты разошлись вдоль разлома протяженностью 150 км, причем в течение нескольких секунд они сместились на расстояние до 3 метров, а в некоторых местах даже больше. То есть Турция, фактически, сдвинулась относительно Сирии на юго-запад, о чем сообщает профессор Карло Доглиони, президент Национального института геофизики и вулканологии.

Сдвиг литосферных плит хорошо виден по деформации железной дороги в Турции

Согласно последним данным итальянских сейсмологов, смещение плит друг относительно друга произошло не только в горизонтальной плоскости, но и вертикальной. Часть территории Турции опустилась на 5-6 метров, в результате чего стране теперь грозит еще и затопление.

По оценкам специалистов, высвободившаяся энергия, вызвавшая землетрясение, по силе равна взрыву 300 средних атомных бомб. Внезапного землетрясения такой мощности на территории Турции еще не было ни разу со времен изучения сейсмологии.

Чем грозит сдвиг литосферных плит?

“Заряженный” стык двух литосферных плит “разрядился”, можно сказать “выстрел” произошел, а значит все самое страшное уже позади. Но действительно ли все закончилось? На самом деле нет. Как мы недавно рассказывали одним толчком землетрясения подобной мощности не ограничиваются. Повторные толчки, или афтершоки, могут длиться на протяжении нескольких дней, месяцев или даже лет. Но, к счастью, их сила с каждым разом ослабевает.

В результате смещения Аравийской и Анатолийской плит, волна землетрясений прокатилась по всему миру

Но больше всего общественность во всем мире напугали сообщения о землетрясениях, которые одновременно стали происходить в самых разных точках планеты, на разных континентах. С чем это связано? После подобных землетрясений возникают сейсмические волны, которые несколько раз обходят Землю. Они могут спровоцировать сейсмическую активность в других регионах, которые совсем не связаны с литосферными плитами, ставшими причиной землетрясения. Но самое неприятное то, что они способны спровоцировать вулканическую активность.

Однако предугадать возможные последствия таких землетрясений ученые не могут. Собственно говоря, даже сами землетрясения предсказать невозможно, не говоря уже о последствиях сейсмических волн. Поэтому остается лишь наблюдать за ситуацией и надеяться на лучшее.

Еще больше интересных материалов вы найдете на нашем ЯНДЕКС.ДЗЕН КАНАЛЕ. Подписывайтесь скорее, чтобы не пропустить самое интересное!

Напоследок напомним, что нынешнее землетрясение в Турции хоть и было чрезвычайно мощным, оно далеко не самое мощное и разрушительное за историю наблюдений. Подробнее узнать о самых разрушительных землетрясениях можно по этой ссылке.